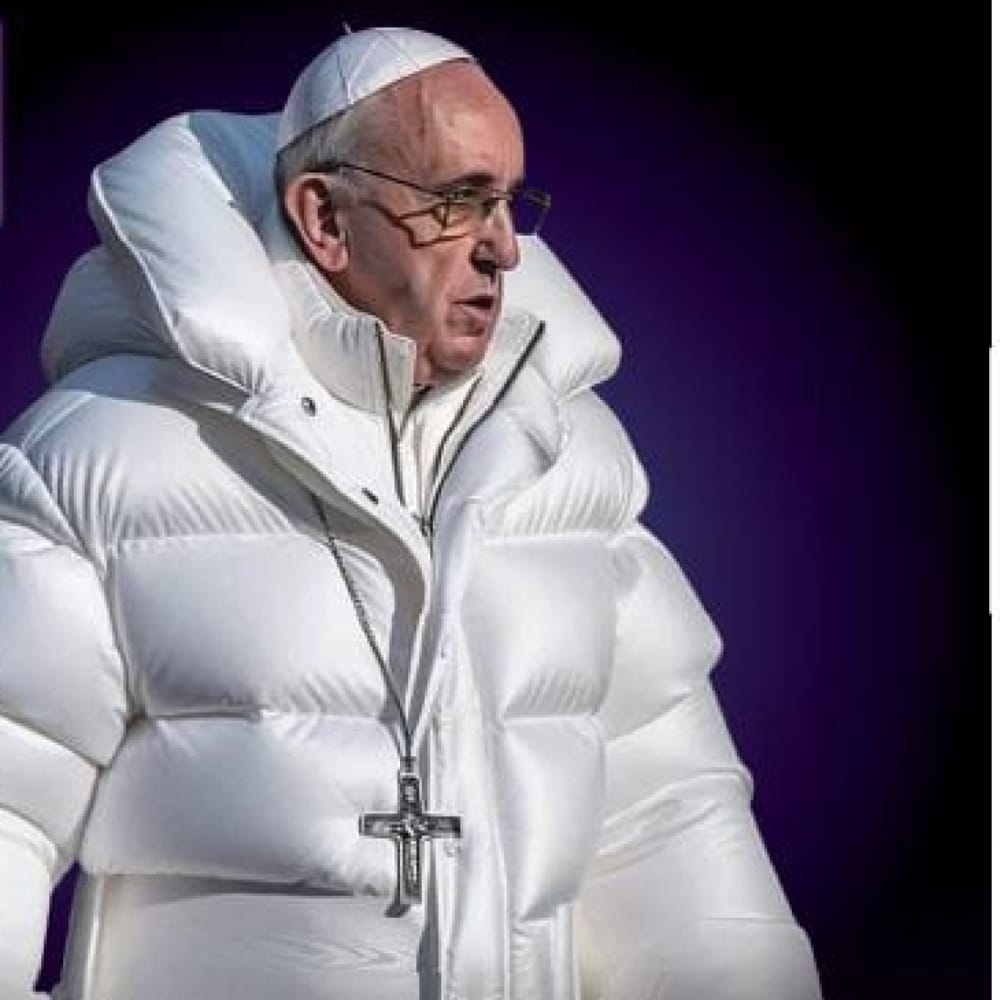

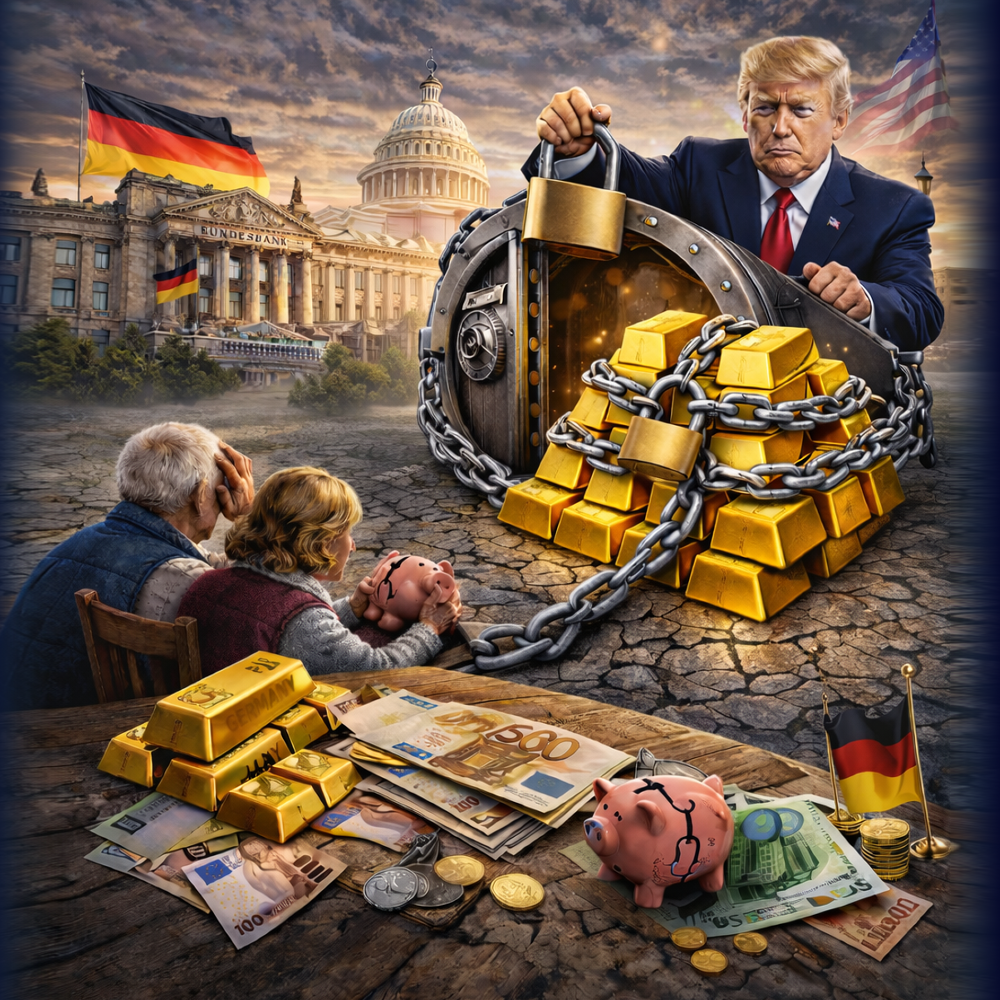

Папа римский Франциск в нелепом белом пуховике. Президент США Дональд Трамп, который оказывает сопротивление полиции при задержании. Бывший канцлер Германии Олаф Шольц делает сальто через трибуну в бундестаге. Все чаще и чаще в Сети появляются захватывающие фото и видео, и пользователи невольно задаются вопросом: «Неужели это правда?». Созданный с помощью искусственного интеллекта (ИИ) ложный контент, так называемые дипфейки, из безобидной забавы может стать реальной угрозой. И по мере совершенствования технологий пользователям будет все труднее распознать подделки. Подобные медиаматериалы манипулируют общественным мнением, распространяют дезинформацию и могут использоваться мошенниками для фальшивых звонков, электронных писем и кражи личных данных.

Дипфейки появились на платформе Reddit в 2017 году. Речь идет о видеороликах порнографического характера, где были вмонтированы лица известных актрис. С тех пор произошел технологический прорыв, и сегодня посредством ИИ можно создавать практически что угодно. Большинство программ находятся в свободном доступе, и они достаточно просты в использовании. Что же делать? Изучить, какие типы дипфейков существуют, и понять, как их распознать.

Правда или ложь?

При создании дипфейков лица и голоса людей монтируются так, чтобы создавалось впечатление, будто все происходит на самом деле. В действительности же герои таких сюжетов ничего подобного не делали. Сегодня программы ИИ способны генерировать изображения и видео людей в новых вымышленных ситуациях. Для этого достаточно одного оригинального фото или короткой аудиозаписи. На этой основе можно создать любой контент. Затем подобные творения стремительно распространяются в социальных сетях, и многие люди принимают их за правду.

Поначалу кажется, что распознать обман очень сложно. В большинстве случаев изображения реалистичны, и даже опытный пользователь может стать жертвой манипуляций. Особенно остро проблема фейкового контента стоит в политике. Например, во время предвыборной гонки перед последними федеральными выборами в Сети появилось видео, где Фридрих Мерц заявляет о презрении к демократии. Этот реалистичный ролик мгновенно разлетелся, и очень многие поверили в его подлинность. Таким образом, подобный контент способен кардинально повлиять на результаты выборов. Можно констатировать, что дипфейки уже стали частью предвыборной кампании, а ведь сфера ИИ постоянно развивается.

В Сети часто публикуют фотографии знаменитостей, созданные ИИ

Реальная опасность

Ложные или частично правдивые новости принято называть фейками. Их могут создавать как люди, так и искусственный интеллект. Дипфейки становятся все более популярным инструментом распространения неверной информации. Например, фейковая новость об аресте Дональда Трампа многим может показаться не такой уж нереальной. А если учесть, что такие сообщения сопровождают фото или видео, то неудивительно, почему они так быстро распространяются и пользуются таким доверием.

Современные пользователи Сети ежедневно сталкиваются с ложной информацией. Порой она совершенно безобидная, а порой и манипулятивная. Естественно, это дестабилизирует общество. По данным компании Bertelsmann за 2024 год, 84 % немцев считают преднамеренное распространение фейков серьезной или очень серьезной проблемой. При этом около 14 % жителей Германии черпают информацию из социальных сетей, где подделки распространяются довольно быстро.

Разоблачение фейков

Главное правило – оставаться предельно внимательным. На многих ложных изображениях все еще присутствуют мелкие неточности, которые каждому вполне по силам подметить.

Например, фон. В большинстве случаев на заднем плане можно рассмотреть некоторые несоответствия, которые позволяют отличить подлинник от подделки, например оторванность объектов от фона, несоответствие света и теней. ИИ создает упрощенные изображения, не передавая всей сложности реальности и не учитывая законов физики.

ИИ испытывает проблемы с некоторыми деталями. Если переизбыток пальцев или путаница с пальцами рук и ног встречаются уже реже, то волосы сгенерированных людей часто выглядят нереалистично, а лица слишком идеальны.

Стоит уделить внимание поведению и взаимодействию людей на фото/видео. В реальной жизни публика всегда эмоционально реагирует на экстраординарные события. В продуктах ИИ нередко люди неестественно спокойны и молчаливы. На фейковом изображении папы Франциска в пуховике окружающие не выражают недоумение либо удивление, а в реальности такое просто невозможно.

При просмотре очередного подозрительного контента задайте себе вопросы: «Логично ли то, что я вижу?», «Согласовываются ли место и время съемки?», «Не напоминает ли этот сюжет фильм?» и т. д. Максимально критичным следует быть, когда речь идет о резонансных событиях. Если в Сети распространяется лишь один кадр, а видео или фото с других ракурсов отсутствуют, это может указывать на дипфейк.

Всегда проверяйте, сообщали ли надежные источники об увиденном событии. Обратите внимание на продолжительность ролика: многие ложные видео очень короткие. Оцените адекватность работы оператора. Например, если показан хаос, а камера двигается плавно, это повод усомниться.

В эпоху технического прогресса не будет лишним обратиться к техническим помощникам. В таких поисковых системах, как Google, Яндекс и Bing, доступен поиск по изображению. Если вам не удается найти фото с других ракурсов, возможно, перед вами творение ИИ. В проверке фактов могут посодействовать такие платформы, как Bellingcat, Mimikama и Correctiv: на этих порталах часто разоблачают фейки. Служба проверки фактов DPA также ежедневно проверяет вирусные изображения, видео и новостные репортажи – актуальные материалы доступны на сайте dpa-factchecking.com.

Выявить творение ИИ может и… сам ИИ! Существуют аналитические инструменты на основе искусственного интеллекта, которые распознают сгенерированные фото, видео, аудио и тексты. В этом помогут такие платформы: Hive, illuminarty.ai, wasitai.com, deepfake-total.com (поиск аудиодипфейков).

Здравый смысл

Не всякий контент, который кажется странным, обязательно сгенерирован ИИ. Нелепыми бывают и реальные фото/видео, на них может наблюдаться искажение пропорций из-за сбоев в работе камеры, плохого освещения или неудачного ракурса. Сохраняя критический взгляд на медиаматериалы, не впадайте в крайности и не причисляйте любой подозрительный контент к подделкам. Обращайте внимание на мелкие детали, анализируйте и на основе этого делайте обоснованную оценку.

И конечно, не нужно считать ИИ врагом всего человечества. Из-за применения в манипулятивных или мошеннических целях ИИ незаслуженно получил дурную славу. А ведь его возможности разумно использовать для решения образовательных, творческих либо развлекательных задач. Программы позволяют экономить время при выполнении ряда процессов, например при создании видео. Такие платформы, как HeyGen и Synthesia, предлагают библиотеку готовых аватаров, или можете генерировать собственных.

ИИ представляет опасность, когда технологии используются в целях создания ложной информации. Учитесь распознавать ее, и тогда искусственный интеллект станет вашим надежным помощником во многих жизненных сферах, позволит экономить время, необходимое для рутинной работы, и добиться большей эффективности.

Обсуждение